ในยุคที่ข้อมูลทางสุขภาพสามารถเข้าถึงได้ภายในไม่กี่วินาที คำถามสำคัญอาจไม่ใช่เพียงว่า เราหาข้อมูลได้หรือไม่ แต่คือ เราควรเชื่อข้อมูลนั้นมากเพียงใด

ปัญญาประดิษฐ์ (artificial intelligence; AI) โดยเฉพาะในรูปแบบโมเดลทางภาษาขนาดใหญ่ (Large Language Models; LLMs) ได้เข้ามามีบทบาทอย่างรวดเร็วในชีวิตประจำวัน รวมถึงในระบบสุขภาพ จากเดิมที่เป็นเพียงเครื่องมือค้นหาข้อมูล แต่ในปัจจุบัน AI สามารถสื่อสาร อธิบายเหตุผล และเสนอแนวทางในลักษณะที่ใกล้เคียงกับการให้คำปรึกษาทางการแพทย์มากขึ้น ด้วยศักยภาพดังกล่าว AI จึงถูกมองว่าอาจเป็น ผู้ช่วยที่ช่วยลดภาระงานของบุคลากรทางสุขภาพ โดยเฉพาะในบริบทที่ต้องเผชิญกับข้อมูลจำนวนมากและความซับซ้อนของผู้ป่วยที่เพิ่มขึ้นอย่างต่อเนื่อง

หนึ่งในตัวอย่างที่เห็นได้ชัดคือการประยุกต์ใช้ AI ในการวิเคราะห์การใช้ยา โดยเฉพาะการตรวจจับอันตรกิริยาระหว่างยา ซึ่งเป็นปัญหาสำคัญในผู้ป่วยที่ใช้ยาหลายชนิดร่วมกัน จากงานวิจัยในประเทศไทย (1) พบว่า LLMs หลายระบบ (เช่น ChatGPT, Gemini, Claude, Perplexity) สามารถตรวจจับอันตรกิริยาระหว่างยา และเสนอแนวทางจัดการได้ในระดับที่ยอมรับได้ทางคลินิก ทั้งในภาษาไทยและภาษาอังกฤษ อย่างไรก็ตาม ประสิทธิภาพดังกล่าวยังมีความแตกต่างกันระหว่างแต่ละโมเดล และไม่ได้มีความสม่ำเสมอในทุกสถานการณ์

ประเด็นที่น่าสนใจยิ่งกว่าศักยภาพของ AI คือ “พฤติกรรมของผู้ใช้”

การศึกษาจากวารสาร NEJM AI (2) พบว่า ผู้ใช้ทั่วไปไม่สามารถแยกแยะได้อย่างมีประสิทธิภาพระหว่างคำแนะนำจาก AI และจากแพทย์ และมีแนวโน้มให้ความเชื่อถือกับคำตอบจาก AI ในระดับสูง แม้ในกรณีที่ข้อมูลนั้นมีความถูกต้องต่ำหรือถูกสร้างขึ้นมาจากแหล่งอ้างอิงที่ไม่ได้มีอยู่จริง ที่สำคัญ ผู้ใช้จำนวนมากยังมีแนวโน้มปฏิบัติตามคำแนะนำดังกล่าว ซึ่งอาจนำไปสู่ผลกระทบที่ไม่พึงประสงค์ เช่น การใช้ยาไม่เหมาะสม หรือการเข้ารับการรักษาโดยไม่จำเป็นไปจนถึงปฏิเสธการรักษา สถานการณ์นี้สะท้อนให้เห็นช่องว่างสำคัญระหว่างความสามารถของตัวเทคโนโลยีและการนำไปใช้งานจริงในทางคลินิก

ในขณะที่ AI สามารถให้คำตอบที่ดูน่าเชื่อถือ มีโครงสร้าง และอ่านเข้าใจง่าย ผู้ใช้อาจตีความว่าคำตอบดังกล่าวมีความถูกต้องทางวิชาการโดยอัตโนมัติ เสมือนเชื่อโดยมิได้มีการไตร่ตรองถี่ถ้วน แม้ในความเป็นจริง AI อาจมีข้อจำกัด เช่น การให้ข้อมูลไม่ครบถ้วน คลุมเครือ การอ้างอิงแหล่งข้อมูลที่ไม่ถูกต้อง หรือไม่มีอยู่จริงและการไม่สามารถปรับข้อมูลให้เหมาะสมกับบริบทเฉพาะของผู้ป่วยแต่ละราย

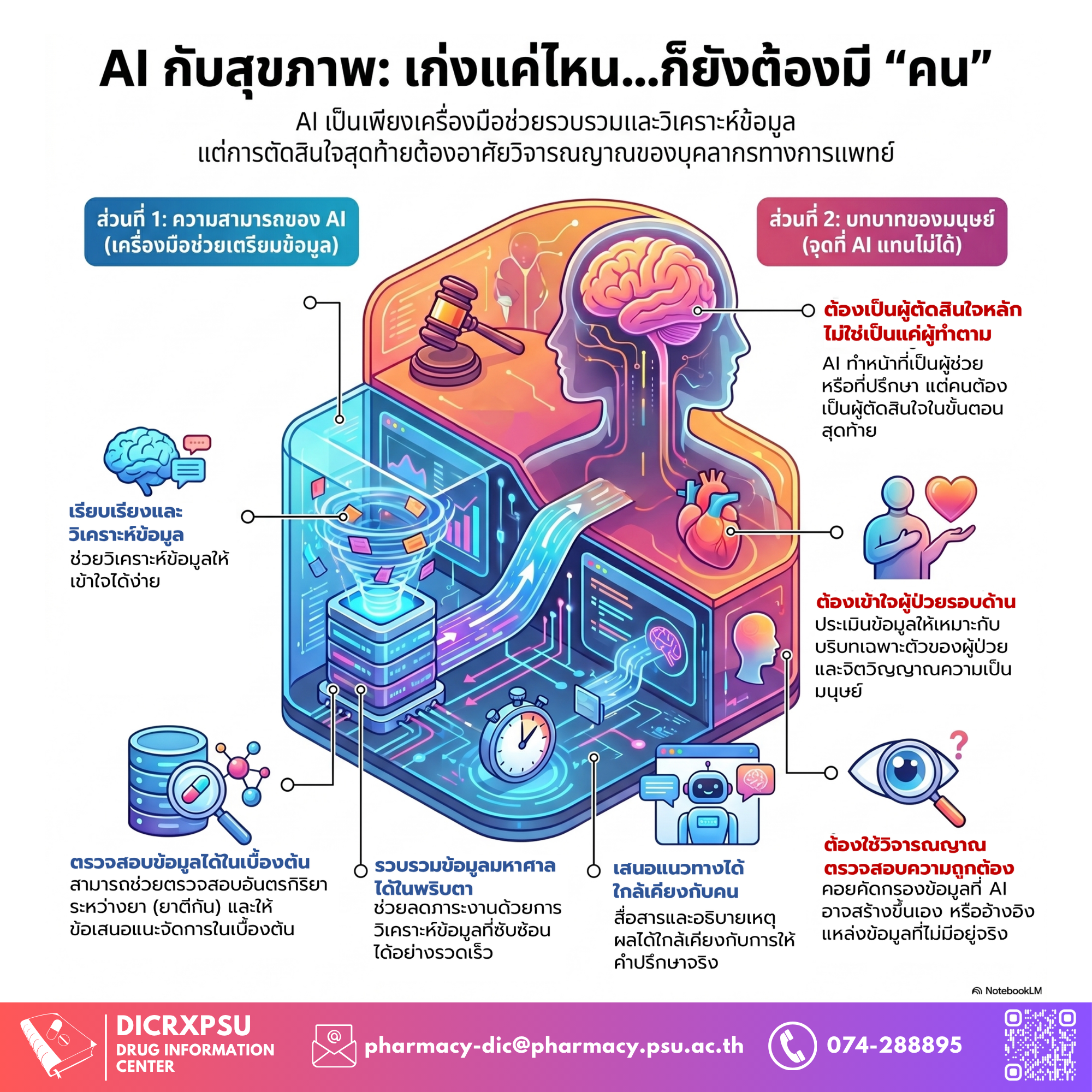

ดังนั้น บทบาทของ AI ในระบบสุขภาพจึงควรถูกวางไว้ในฐานะเพียง “เครื่องมือสนับสนุนการตัดสินใจ” เท่านั้น AI สามารถทำได้ดีในการเป็นผู้ช่วยรวบรวมข้อมูล วิเคราะห์เบื้องต้น และเตือนความเสี่ยงที่อาจถูกมองข้าม แต่การตัดสินใจสุดท้ายยังคงต้องอาศัยการพิจารณาจากบุคลากรทางสุขภาพตามแต่ละความชำนาญของแต่ละวิชาชีพ ซึ่งสามารถประเมินบริบทของผู้ป่วยได้อย่างรอบด้าน มีความเข้าใจผู้ป่วย สะท้อนถึงจิตวิญญาณของการช่วยเหลือเพื่อนมนุษย์ อย่างไรก็ตามแนวคิดการผนวก AI ในงานด้านการบริการสุขภาพนี้มีความสอดคล้องกับหลักการของการใช้ข้อมูลด้านสุขภาพอย่างเหมาะสม ซึ่งเน้นว่าข้อมูลทั่วไปไม่สามารถนำไปใช้แทนคำแนะนำเฉพาะบุคคลได้ และควรมีการปรึกษาผู้เชี่ยวชาญก่อนการตัดสินใจในสถานการณ์จริง

ในอนาคต การทำงานร่วมกันระหว่างมนุษย์และ AI อาจไม่ใช่ทางเลือก แต่เป็นสิ่งที่หลีกเลี่ยงไม่ได้ เช่นเดียวกับที่ google search ได้กลายเป็นส่วนหนึ่งของการใช้ชีวิตตลอดหลายสิบปีที่ผ่านมา

AIทำหน้าที่ช่วยเพิ่มความรวดเร็วและความครอบคลุมของข้อมูล ขณะที่บุคลากรทางการแพทย์ยังคงเป็นผู้ดูแลที่มีความเข้าใจผู้ป่วยในมิติที่ลึกซึ้ง ท้ายที่สุด ความท้าทายของ AI ในระบบสุขภาพ อาจไม่ใช่การทำให้เทคโนโลยีฉลาดขึ้นเพียงอย่างเดียวแต่คือการทำให้มนุษย์ใช้เทคโนโลยีอย่างมีวิจารณญาณมากขึ้น

เอกสารอ้างอิง

1. Boonrit N, Thaweechai A, Kessarin B, Ruanglertboon W. Capabilities of large language models in detecting and managing drug interactions during medication reviews: potential implications as a digital assistant for pragmatic pharmacy practice in Thailand. J Am Coll Clin Pharm. 2025;8(11):1117-1128. doi:10.1002/jac5.70115

2. Sarabu C, et al. People overtrust AI-generated medical advice despite low accuracy. NEJM AI. 2025;2(6). doi:10.1056/AIoa2300015.

จัดทำและเรียบเรียงโดย

ผศ.ดร.ภก.วริทธิ์ เรืองเลิศบุญ, อ.ภก.นันทพงศ์ บุญฤทธิ์, นศภ.อชิรญา ทวีชัย, นศภ.บุษบง เกษรินทร์ และ นายมัชฌิม อดุลตระกูล

©2026 by DICRXPSU This work is licensed under CC BY-NC 4.0

การนำบทความนี้ไปเผยแพร่ หรือการคัดลอกส่วนใดส่วนหนึ่งของบทความกรุณาอ้างอิงหรือขออนุญาตก่อนการเผยแพร่